You are looking for information, articles, knowledge about the topic nail salons open on sunday near me 파이썬 딥 페이크 on Google, you do not find the information you need! Here are the best content compiled and compiled by the toplist.prairiehousefreeman.com team, along with other related topics such as: 파이썬 딥 페이크 딥페이크 처벌, Face Swap 사용법, 딥페이크 만들기 사이트, 딥페이크 github, 딥페이크 시청 처벌, Deep Swap 사용법, Faceswap, Face Swap 사진

딥페이크 구현하기 faceswap (1) : 네이버 블로그

- Article author: m.blog.naver.com

- Reviews from users: 18415

Ratings

- Top rated: 4.3

- Lowest rated: 1

- Summary of article content: Articles about 딥페이크 구현하기 faceswap (1) : 네이버 블로그 이번장에서는 딥페이크 기법으로 영상을 만드는걸 파이썬으로 구현해보기로 한다. 딥페이크 기술이 무엇인지 잘 모르는 사람을 위해 딥페이크에 대해 … …

- Most searched keywords: Whether you are looking for 딥페이크 구현하기 faceswap (1) : 네이버 블로그 이번장에서는 딥페이크 기법으로 영상을 만드는걸 파이썬으로 구현해보기로 한다. 딥페이크 기술이 무엇인지 잘 모르는 사람을 위해 딥페이크에 대해 …

- Table of Contents:

카테고리 이동

AI딥러닝 c# python

이 블로그

프로그래밍

카테고리 글

카테고리

이 블로그

프로그래밍

카테고리 글

딥페이크 하는 법 – 파이썬 Faceswap – KPOP Deepfakes

- Article author: kpopdeepfakes.net

- Reviews from users: 31134

Ratings

- Top rated: 4.4

- Lowest rated: 1

- Summary of article content: Articles about 딥페이크 하는 법 – 파이썬 Faceswap – KPOP Deepfakes 딥페이크 하는 법 – 파이썬 Faceswap English · 1. 선행 요건 · 2. 파이썬: faceswap 폴더 구조 · 3. 파이썬: 추출 – (DataB) 아이돌 얼굴셋 만들기 · 4. 파이썬: 추출 – ( … …

- Most searched keywords: Whether you are looking for 딥페이크 하는 법 – 파이썬 Faceswap – KPOP Deepfakes 딥페이크 하는 법 – 파이썬 Faceswap English · 1. 선행 요건 · 2. 파이썬: faceswap 폴더 구조 · 3. 파이썬: 추출 – (DataB) 아이돌 얼굴셋 만들기 · 4. 파이썬: 추출 – ( …

- Table of Contents:

1선행 요건

2 파이썬 faceswap 폴더 구조

3 파이썬 추출 – (DataB) 아이돌 얼굴셋 만들기

4 파이썬 추출 – (DataA) 모델 얼굴셋 만들기

5 파이썬 학습

6 파이썬 변환

Congratulations!

Questions Comments

[Deep Fake Tutorial] 나만의 딥페이크(Deep fake) 만들기(수지를 아이유로?)

- Article author: wonder-j.tistory.com

- Reviews from users: 26769

Ratings

- Top rated: 4.6

- Lowest rated: 1

- Summary of article content: Articles about [Deep Fake Tutorial] 나만의 딥페이크(Deep fake) 만들기(수지를 아이유로?) [Deep Fake Tutorial] 나만의 딥페이크(Deep fake) 만들기(수지를 아이유로?) … conda create -y -n deepfacelab python=3.6.6 cudatoolkit=9.0 … …

- Most searched keywords: Whether you are looking for [Deep Fake Tutorial] 나만의 딥페이크(Deep fake) 만들기(수지를 아이유로?) [Deep Fake Tutorial] 나만의 딥페이크(Deep fake) 만들기(수지를 아이유로?) … conda create -y -n deepfacelab python=3.6.6 cudatoolkit=9.0 … DFL(DeepFaceLab)실행 환경 설정 DFL은 중국에서 개발 및 배포된 소스로, 소스 영상에서 얼굴을 추출하여 타겟 영상에 합성, 손쉽게 Deep fake를 만들 수 있음 출처 : DeepFaceLab 아나콘다 설치 DFL 가상환경 만..모든 궁금증과 그 해답을 담는 공간

Github : https://github.com/JaeheeRyu - Table of Contents:

DFL(DeepFaceLab)실행 환경 설정

DFL 실행

![[Deep Fake Tutorial] 나만의 딥페이크(Deep fake) 만들기(수지를 아이유로?)](https://img1.daumcdn.net/thumb/R800x0/?scode=mtistory2&fname=https%3A%2F%2Fblog.kakaocdn.net%2Fdn%2Fv8gya%2FbtqD8OAi2Uu%2Fx3ur4RTtkNGz0HYsk1d3AK%2Fimg.png)

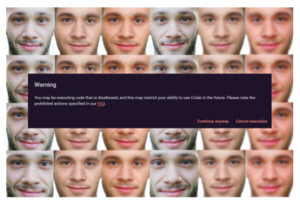

구글, 코렙(Colab)에서 딥페이크 생성 AI 금지 < 정책 < 기사본문 - AI타임스

- Article author: www.aitimes.com

- Reviews from users: 38120

Ratings

- Top rated: 4.4

- Lowest rated: 1

- Summary of article content: Articles about 구글, 코렙(Colab)에서 딥페이크 생성 AI 금지 < 정책 < 기사본문 - AI타임스 ... 변경해 이 서비스를 더 이상 딥페이크 훈련에 사용할 수 없다는 조항을 추가했다.코렙은 누구나 웹 브라우저를 통해 임의의 파이썬(Python) 코드, ... ...

- Most searched keywords: Whether you are looking for 구글, 코렙(Colab)에서 딥페이크 생성 AI 금지 < 정책 < 기사본문 - AI타임스 ... 변경해 이 서비스를 더 이상 딥페이크 훈련에 사용할 수 없다는 조항을 추가했다.코렙은 누구나 웹 브라우저를 통해 임의의 파이썬(Python) 코드, ... 구글이 코렙(Colab, Colaboratory) 플랫폼에서 딥페이크를 생성하는 데 사용할 수 있는 AI 시스템의 학습을 금지했다. 구글은 코렙 사용자를 위한 서비스 약관을 변경해 이 서비스를 더 이상 딥페이크 훈련에 사용할 수 없다는 조항을 추가했다.코렙은 누구나 웹 브라우저를 통해 임의의 파이썬(Python) 코드, 특히 기계 학습 및 데이터 분석을 위한 코드를 작성하고 실행하는 동시에 모든 사용자에게 GPU 및 구글의 AI 가속 텐서 처리 장치(TPU)를 포함한 하드웨어에 대한 무료 액세스를 제공하는 온라인 컴퓨팅 리소스다.최코렙,딥페이크,딥페이스랩,구글,페이스스왑,Colab,Deepfake,DeepFaceLab,FaceSwap

- Table of Contents:

Deepfake Tutorial – 자신만의 딥페이크를 만들어 보자 (0부터 100까지)

- Article author: blog.system32.kr

- Reviews from users: 11513

Ratings

- Top rated: 3.3

- Lowest rated: 1

- Summary of article content: Articles about Deepfake Tutorial – 자신만의 딥페이크를 만들어 보자 (0부터 100까지) 먼저 FaceSwap 즉, Deepfake를 구현하기 위해서는 VGA와 CPU의 성능이 좋아야합니다. 딥페이크를 구현하기 이전, CUDA와 tensorflow를 설치해보도록 … …

- Most searched keywords: Whether you are looking for Deepfake Tutorial – 자신만의 딥페이크를 만들어 보자 (0부터 100까지) 먼저 FaceSwap 즉, Deepfake를 구현하기 위해서는 VGA와 CPU의 성능이 좋아야합니다. 딥페이크를 구현하기 이전, CUDA와 tensorflow를 설치해보도록 … 먼저 본 글을 통해서 악의적이나 불법적으로 이용할 경우, 어떠한 책임도 지지 않음을 알려드립니다. 본 글을 쓴 목적은, 예전부터 흥미를 가졌던 FaceSwap과 VoiceSwap 두개중 먼저 FaceSwap(얼굴 교체)에 대해..

- Table of Contents:

댓글

이 글 공유하기

다른 글

[CentOS7] CentOS7에 APM 설치하기 & PHP 로그인 [Python] Pyinstaller Decompile (암호화되어 있는 바이너리 디컴파일) [Arduino] OLED 모듈과 온습도 센서 사용DRM to PDF

티스토리툴바

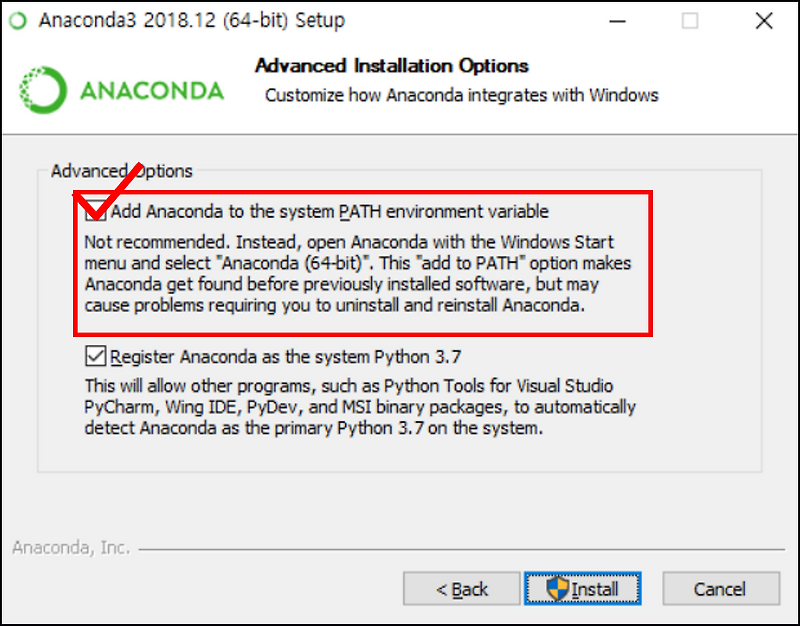

딥페이크, 얼굴 바꾸기: Faceswap 설치 및 사용법 (1)

- Article author: sjblog1.tistory.com

- Reviews from users: 13401

Ratings

- Top rated: 3.1

- Lowest rated: 1

- Summary of article content: Articles about 딥페이크, 얼굴 바꾸기: Faceswap 설치 및 사용법 (1) Anaconda 아나콘다 설치. Faceswap은 파이썬을 기반으로 실행되기 때문에 파이썬을 설치해야 합니다. 라이브러리 설치와 설치 과정에서 오류를 최소화 … …

- Most searched keywords: Whether you are looking for 딥페이크, 얼굴 바꾸기: Faceswap 설치 및 사용법 (1) Anaconda 아나콘다 설치. Faceswap은 파이썬을 기반으로 실행되기 때문에 파이썬을 설치해야 합니다. 라이브러리 설치와 설치 과정에서 오류를 최소화 … 1. Anaconda 아나콘다 설치 Faceswap은 파이썬을 기반으로 실행되기 때문에 파이썬을 설치해야 합니다. 라이브러리 설치와 설치 과정에서 오류를 최소화하기 위해 아나콘다를 이용해봅시다. www.anaconda.com/prod..

- Table of Contents:

sjblog

딥페이크 얼굴 바꾸기 Faceswap 설치 및 사용법 (1) 본문

티스토리툴바

[코드학습후기] 딥페이크 코드 실행 후기 _ Deepfacelab_01 :: 딥러닝 학습하기

- Article author: didiforcoding.tistory.com

- Reviews from users: 19387

Ratings

- Top rated: 4.5

- Lowest rated: 1

- Summary of article content: Articles about [코드학습후기] 딥페이크 코드 실행 후기 _ Deepfacelab_01 :: 딥러닝 학습하기 Install DeepFaceLab. 출처 : github. conda create -n deepfacelab -c main python=3.7 cudnn=7.6. …

- Most searched keywords: Whether you are looking for [코드학습후기] 딥페이크 코드 실행 후기 _ Deepfacelab_01 :: 딥러닝 학습하기 Install DeepFaceLab. 출처 : github. conda create -n deepfacelab -c main python=3.7 cudnn=7.6. 2021.03.23 – [Paper Review] – [Survey] DeepFakes and Beyond: A Survey of Face Manipulation and Fake Detection 정리 및 요약 – 1 Intro [Survey] DeepFakes and Beyond: A Survey of Face Manipulation and..체화해서 내 단어로 설명할 수 있을때 까지 !

딥러닝 러닝하기 ~ ” - Table of Contents:

관련글 관련글 더보기

인기포스트

![[코드학습후기] 딥페이크 코드 실행 후기 _ Deepfacelab_01 :: 딥러닝 학습하기](https://img1.daumcdn.net/thumb/R800x0/?scode=mtistory2&fname=https%3A%2F%2Fblog.kakaocdn.net%2Fdn%2FpJRoH%2Fbtq0Y4n8P2V%2FhWGPKQZbNDNPMctbFn3GWk%2Fimg.png)

Deepfakes step-by-step with DeepFaceLab / Python Face Swap | Udemy

- Article author: www.udemy.com

- Reviews from users: 36363

Ratings

- Top rated: 3.5

- Lowest rated: 1

- Summary of article content: Articles about Deepfakes step-by-step with DeepFaceLab / Python Face Swap | Udemy This course shows the current state of the art of future-oriented technology machine learning with a specific application, namely the exchange of faces in a … …

- Most searched keywords: Whether you are looking for Deepfakes step-by-step with DeepFaceLab / Python Face Swap | Udemy This course shows the current state of the art of future-oriented technology machine learning with a specific application, namely the exchange of faces in a … Create deepfakes yourself with DeepFaceLab + Realtime Avatars with Avatarify

- Table of Contents:

What you’ll learn

Requirements

Description

Who this course is for

Instructor

데이터경영학과 | (파이썬)zoom을 할 때 내가 아닌 아인슈타인이 되는 방법

- Article author: biz.cha.ac.kr

- Reviews from users: 35943

Ratings

- Top rated: 3.2

- Lowest rated: 1

- Summary of article content: Articles about 데이터경영학과 | (파이썬)zoom을 할 때 내가 아닌 아인슈타인이 되는 방법 이 기술은 딥페이크를 이용한 기술이며 관련 설명은 이곳을 눌러 확인해주세요. 저같이 파이썬을 능숙하게 다루지 못하여도 개발자의 설명을 보고 하면 어렵지 … …

- Most searched keywords: Whether you are looking for 데이터경영학과 | (파이썬)zoom을 할 때 내가 아닌 아인슈타인이 되는 방법 이 기술은 딥페이크를 이용한 기술이며 관련 설명은 이곳을 눌러 확인해주세요. 저같이 파이썬을 능숙하게 다루지 못하여도 개발자의 설명을 보고 하면 어렵지 …

- Table of Contents:

See more articles in the same category here: Top 159 tips update new.

딥페이크 구현하기 faceswap (1) : 네이버 블로그

인공지능 기술을 활용해 기존의 인물의 얼굴이나, 특정한 부위를 영화의 CG처럼 합성한 영상 편집물을 말한다. 그 전에는 사진이나 영상을 편집프로그램으로 조악하게 합성해 게시하던게 디지털 기술과 인공지능의 발전으로 몇단계 정교해진 것이다.

원리 자체는 간단한데 합성하려는 인물의 얼굴이 주로 나오는 고화질의 동영상을 딥러닝 기법에 의해 취득한 후, 대상이 되는 동영상에 프레임 단위로 합성시키는 것이다.

머리 외곽선을 통째로 합성하는건 아니고, 안면 윤곽 안쪽과 피부톤을 맞쳐서 합성해가는데, 이게 엄청 정교해 보이는게 음성에는 손을 안대지만 입모양과 얼굴 표정을 완전 정교하게 매칭시켜서 합성하기 때문에 정말 데이터가 많은 딥페이크 영상은 원본과 구별하기가 매우 힘들다.

단점은, 영상의 화질이나, 처리되는 데이터가 적게되면, 조악하게 나온다는건데, 이게 요새같이 디지털 미디어에 얼굴이나 영상등이 나오는 유명인의 경우 데이터가 많아서 문제가 안된다.

그래서 현재 가장 문제되는게, 포르노 영상인데, 유명배우들이나 유명인들을 이용한 딥페이크 포르노가 너무나 정교해져서 가장 큰 문제가 되고 있다.

이게 만일 일반인으로까지 공포가 시작되면 SNS 활용폭이 매우 극단적으로 낮아지고 있어 한편으로는 딥페이크영상을 걸러내는 기술자체를 페이스북에서 캐글에 $1,000,000 상금을 걸고 최근에 개최하기도 했었다.

딥페이크 하는 법 – 파이썬 Faceswap

딥페이크 하는 법 – 파이썬 Faceswap English

Updated 2018/12/09

For DeepFaceLab, visit here (advanced users only)

다른 질문사항이 있다면 Deepfake Tech 게시판에 자유롭게 질문 해주세요!

1.선행 요건

최신 Nvidia 그랙카드 드라이버 설치

고성능 CPU와 더불어 VRAM(그래픽 카드 메모리) 2GB, compute capability 3.0이상의 GPU가 필요합니다.

GPU의 compute capability는 이 목록에서 확인하시고 3.0 미만이시면 포기하셔야 됩니다.

목록에 게재 되어있지 않은 GPU는 사용 불가능합니다.

최소사양을 충족 하신다면 GeForce Experience에서 GPU 드라이버를 최신버전으로 업데이트 하세요.

CUDA 9.0

Expand +++Tensorflow가 9.1 버젼과는 호환이 안되니 9.1은 절대 받지 마세요!!+++

사용하실 컴퓨터에 적합한 설정을 선택하시고 Installer Type을 exe (local)로 설정하신후 CUDA 9.0를 다운로드하세요.

설치화면이 뜨면 Custom Install 선택하신후 CUDA와 Other components 항목만 체크하시고 설치하세요.

+++Tensorflow가 9.1 버젼과는 호환이 안되니 9.1은 절대 받지 마세요!!+++

사용하실 컴퓨터에 적합한 설정을 선택하시고 Installer Type을 exe (local)로 설정하신후 CUDA 9.0를 다운로드하세요.

설치화면이 뜨면 Custom Install 선택하신후 CUDA와 Other components 항목만 체크하시고 설치하세요.

cudNN 7

Expand +++중요: Tensoflow는 cudnn 7.1.4와 호환되므로 절대 상위 버젼인 7.1을 받지 마세요!+++

여기에 회원가입 하신후 cuDNN v7.1.4 (May 16, 2018), for CUDA 9.0를 다운로드 하세요. 무조건 Windows 7/10용 cudNN v7.1.4 Library로 하세요!!. 자세한 설치방법은 항목 4.3에설명 되어 있습니다. 항목 4.3 한글 번역 다운받은 cudnn-9.0-windows10-x64-v7.1.zip 또는 cudnn-9.0-windows10-x64-v7.1.zip의 압축을 풀어줍니다 아래의 파일들을 해당 폴더로 옮깁니다: • cuda\bin\cudnn64_7.dll을 복사하여 C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v9.0\bin에 붙여넣기 합니다. • cuda\ include\cudnn.h을 복사하여 C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v9.0\include에 붙여넣기 합니다. • cuda\lib\x64\cudnn.lib을 복사하여 C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v9.0\lib\x64에 붙여넣기 합니다. cuDNN 위치를 환경변수에 추가 윈도우에 “환경변수 설정”을 검색합니다. 고급 설정(Advanced) -> 환경 변수(Environment Variables) 로 들어갑니다 새로 만들기(New)를 클릭하여 “변수 이름: CUDA_PATH”과 “변수 값: C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v9.0″을 추가합니다.

이미 추가가 되어 있는 경우에는 놔두셔도 됩니다. +++중요: Tensoflow는 cudnn 7.1.4와 호환되므로 절대 상위 버젼인 7.1을 받지 마세요!+++

여기에 회원가입 하신후 cuDNN v7.1.4 (May 16, 2018), for CUDA 9.0를 다운로드 하세요. 무조건 Windows 7/10용 cudNN v7.1.4 Library로 하세요!!. 자세한 설치방법은 항목 4.3에설명 되어 있습니다. 항목 4.3 한글 번역 다운받은 cudnn-9.0-windows10-x64-v7.1.zip 또는 cudnn-9.0-windows10-x64-v7.1.zip의 압축을 풀어줍니다 아래의 파일들을 해당 폴더로 옮깁니다: • cuda\bin\cudnn64_7.dll을 복사하여 C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v9.0\bin에 붙여넣기 합니다. • cuda\ include\cudnn.h을 복사하여 C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v9.0\include에 붙여넣기 합니다. • cuda\lib\x64\cudnn.lib을 복사하여 C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v9.0\lib\x64에 붙여넣기 합니다. cuDNN 위치를 환경변수에 추가 윈도우에 “환경변수 설정”을 검색합니다. 고급 설정(Advanced) -> 환경 변수(Environment Variables) 로 들어갑니다 새로 만들기(New)를 클릭하여 “변수 이름: CUDA_PATH”과 “변수 값: C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v9.0″을 추가합니다.

이미 추가가 되어 있는 경우에는 놔두셔도 됩니다.

ffmpeg

Expand 여기서 ffmpeg를 다운로드 하시고 C:\ 루트 디렉토리에 압축 풀어주세요. (최종 디렉토리: C:\ffmpeg-4.1-win64-static) 명령 프롬프트(cmd)에서 사용할수 있도록 ffmpeg를 시스템 환경 변수에 추가합니다. 윈도우 파일 검색창에 “Edit the system environment variables”를 입력하시고 오른쪽 아래에 있는 “Environment Variables…”을 클릭하세요.

그 다음 System Variables 설정탭에 있는 “Path” 항목을 선택하시고 편집버튼을 클릭 해주세요.

새로 뜬 창 오른편에 있는 “새로 만들기(New)”를 클릭하시고 아래의 경로를 추가해주세요. C:\ffmpeg-4.1-win64-static\bin 여기서 ffmpeg를 다운로드 하시고 C:\ 루트 디렉토리에 압축 풀어주세요. (최종 디렉토리: C:\ffmpeg-4.1-win64-static) 명령 프롬프트(cmd)에서 사용할수 있도록 ffmpeg를 시스템 환경 변수에 추가합니다. 윈도우 파일 검색창에 “Edit the system environment variables”를 입력하시고 오른쪽 아래에 있는 “Environment Variables…”을 클릭하세요.

그 다음 System Variables 설정탭에 있는 “Path” 항목을 선택하시고 편집버튼을 클릭 해주세요.

새로 뜬 창 오른편에 있는 “새로 만들기(New)”를 클릭하시고 아래의 경로를 추가해주세요. C:\ffmpeg-4.1-win64-static\bin

Python 3.6.7 (다운 링크)

Cmake 및 Microsoft Visual Studio 2015 C++ Build Tools 설치

Expand 아래의 명령어를 입력합니다 pip install cmake 그리고 여기서 Microsoft Visual Studio 2015 C++ Build Tools installer를 다운 받습니다. 설치시에 custom install을 고르시고, 다음에 “Windows 8.1 SDK” 와 “Windows 10 SDK”를 체크하고 설치를 계속 진행해주세요

아래의 명령어를 입력합니다 pip install cmake 그리고 여기서 Microsoft Visual Studio 2015 C++ Build Tools installer를 다운 받습니다. 설치시에 custom install을 고르시고, 다음에 “Windows 8.1 SDK” 와 “Windows 10 SDK”를 체크하고 설치를 계속 진행해주세요

Faceswap 설치

Expand 파이썬 faceswap을 여기서 받습니다:

압축을 풀고 “faceswap-master” 폴더를 C 드라이브로 옮긴 후 “faceswap” 으로 이름을 변경합니다 (C:\faceswap). cmd를 실행하고 아래의 명령어를 입력합니다 (cmd 켜는 방법 모르시면 여기를 참조): cd /d “C:\faceswap” && python setup.py 그러면 아래와 같은 화면이 뜰 것입니다. INFO The tool provides tips for installation and installs required python packages INFO Setup in Windows 10 INFO Installed Python: 3.6.5 64bit INFO Installed PIP: 10.0.1 Enable Docker? [Y/n] n <----- INFO Docker Disabled Enable CUDA? [Y/n] Y <----- INFO CUDA Enabled INFO Tensorflow has no official prebuilts for CUDA 9.1 currently. ...... WARNING Cannot find CUDA on non-Linux system Manually specify CUDA version: 9.0 Are System Dependencies met? [y/N] y <----- INFO Installing Missing Python Packages... INFO Installing tensorflow-gpu INFO Installing pathlib==1.0.1 ...... INFO Installing tqdm INFO Installing matplotlib INFO All python3 dependencies are met. You are good to go. “<——“의 왼쪽에는 질문에 대한 답이 요구되며, 위에 제시되어 있는 답을 쓰세요. 예를 들어 “Enable CUDA? [Y/n]” 라고 했을 때는 n을 입력하고 엔터를 누르세요. CUDA의 버젼을 물을 때는 9.0이라고 쓰고 엔터를 누르세요. 모든 게 정상적으로 진행 됐다면 넘어가시고, 성공하지 않으셨다면 아래의 과정을 따라하세요. cmd를 켜고 아래의 명령어를 입력합니다. cd /d "C:\faceswap" && pip install -r requirements.txt 컴퓨터가 자동적으로 텍스트를 UTF-8 포맷으로 변경하지 않아서 오류가 날 경우 아래의 스크린샷처럼 requirements.txt를 연 후 UTF-8 포맷으로 저장합니다: cmd를 켜고 아래의 명령어를 입력합니다. pip install tensorflow-gpu==1.11.0 파이썬 faceswap을 여기서 받습니다: 압축을 풀고 “faceswap-master” 폴더를 C 드라이브로 옮긴 후 “faceswap” 으로 이름을 변경합니다 (C:\faceswap). cmd를 실행하고 아래의 명령어를 입력합니다 (cmd 켜는 방법 모르시면 여기를 참조): cd /d "C:\faceswap" && python setup.py 그러면 아래와 같은 화면이 뜰 것입니다. INFO The tool provides tips for installation and installs required python packages INFO Setup in Windows 10 INFO Installed Python: 3.6.5 64bit INFO Installed PIP: 10.0.1 Enable Docker? [Y/n] n <----- INFO Docker Disabled Enable CUDA? [Y/n] Y <----- INFO CUDA Enabled INFO Tensorflow has no official prebuilts for CUDA 9.1 currently. ...... WARNING Cannot find CUDA on non-Linux system Manually specify CUDA version: 9.0 Are System Dependencies met? [y/N] y <----- INFO Installing Missing Python Packages... INFO Installing tensorflow-gpu INFO Installing pathlib==1.0.1 ...... INFO Installing tqdm INFO Installing matplotlib INFO All python3 dependencies are met. You are good to go. “<——“의 왼쪽에는 질문에 대한 답이 요구되며, 위에 제시되어 있는 답을 쓰세요. 예를 들어 “Enable CUDA? [Y/n]” 라고 했을 때는 n을 입력하고 엔터를 누르세요. CUDA의 버젼을 물을 때는 9.0이라고 쓰고 엔터를 누르세요. 모든 게 정상적으로 진행 됐다면 넘어가시고, 성공하지 않으셨다면 아래의 과정을 따라하세요. cmd를 켜고 아래의 명령어를 입력합니다. cd /d "C:\faceswap" && pip install -r requirements.txt 컴퓨터가 자동적으로 텍스트를 UTF-8 포맷으로 변경하지 않아서 오류가 날 경우 아래의 스크린샷처럼 requirements.txt를 연 후 UTF-8 포맷으로 저장합니다: cmd를 켜고 아래의 명령어를 입력합니다. pip install tensorflow-gpu==1.11.0 2. 파이썬: faceswap 폴더 구조 Expand 아래의 코드를 입력하여 실행되는지 확인하시기 바랍니다. 여기서 dlib 관련 에러가 발생하면 설치과정 중에 실수를 했을 수도 있습니다. cd /d "C:\faceswap" && python faceswap.py -h faceswap 폴더 안에 “DataA”와 “DataB”라는 두가지의 폴더를 만듭니다: 다음과 같은 추가적인 폴더를 만듭니다: C:\faceswap\DataA\actress1 -> 모델 영상 프레임/이미지 C:\faceswap\DataA\actress1\extracted -> 모델 영상 프레임/이미지에서 추출된 얼굴 C:\faceswap\DataB\idol1 -> 아이돌 영상 프레임/이미지 C:\faceswap\DataB\idol1\extracted -> 아이돌 영상 프레임/이미지에서 추출된 얼굴 C:\faceswap\DataA\model -> 학습시에 생성되는 파일들이 저장됩니다. 학습 시작시에 자동적으로 생기므로 안 만드셔도 됩니다. C:\faceswap\DataA\model\model1 -> 학습시에 생성되는 파일들이 저장됩니다. 학습 시작시에 자동적으로 생기므로 안 만드셔도 됩니다.

아래의 코드를 입력하여 실행되는지 확인하시기 바랍니다. 여기서 dlib 관련 에러가 발생하면 설치과정 중에 실수를 했을 수도 있습니다. cd /d “C:\faceswap” && python faceswap.py -h faceswap 폴더 안에 “DataA”와 “DataB”라는 두가지의 폴더를 만듭니다:

다음과 같은 추가적인 폴더를 만듭니다: C:\faceswap\DataA\actress1 -> 모델 영상 프레임/이미지 C:\faceswap\DataA\actress1\extracted -> 모델 영상 프레임/이미지에서 추출된 얼굴 C:\faceswap\DataB\idol1 -> 아이돌 영상 프레임/이미지 C:\faceswap\DataB\idol1\extracted -> 아이돌 영상 프레임/이미지에서 추출된 얼굴 C:\faceswap\DataA\model -> 학습시에 생성되는 파일들이 저장됩니다. 학습 시작시에 자동적으로 생기므로 안 만드셔도 됩니다. C:\faceswap\DataA\model\model1 -> 학습시에 생성되는 파일들이 저장됩니다. 학습 시작시에 자동적으로 생기므로 안 만드셔도 됩니다.

3. 파이썬: 추출 – (DataB) 아이돌 얼굴셋 만들기

Expand 얼굴셋을 준비하기 위한 과정입니다. 얼굴셋이란? 256×256 이미지 크기의 아이돌 얼굴 모음집 몇개의 이미지가 한 셋에 포함되어야 할까? 효과적이고 빠른 학습을 위해서는 300~1000개 사이가 좋습니다 이미지의 품질은 어때야 될까? 얼굴이 명확해 보이는 빛 밝기, 흐림이 없고, 다른 물체(머리카락,병,마이크 등)가 얼굴을 가리지 않은 이미지가 좋습니다. 그리고 최대한 다양한 각도(위,아래,옆)와 표정이 있는 얼굴이 있는 것이 좋습니다. 특히 고개를 위로 들거나 아래로 숙인 얼굴은 찾기 어려우므로 고생하실 수도 있습니다 그래서 얼굴셋을 만드는 방법은? 가장 쉬운 방법은 다른 유저들이 만든 얼굴셋을 사용하는 겁니다. 다운받은 얼굴들을 (C:\faceswap\DataB\idol1\extracted)와 같은 경로로 복붙합니다.또는! 본인이 직접 만드시고 싶다면 faceswap을 이용하여 얼굴을 추출하여야 합니다. 목표 아이돌의 이미지를 구글 검색, pinterest 등에서 얻어서 C:\faceswap\DataB\idol1로 복붙합니다 가장 좋은 방법은 영상에서 얼굴을 얻는 것이며 이를 인터뷰, 직캠, 뮤비 등에서 얻을 수 있습니다. 영상들을 모두 C:\faceswap\DataB\idol1로 이동시킵니다 CMD를 실행시키고 아래와 같은 명령어를 입력하여 ffmpeg가 영상으로부터 프레임(이미지)을 추출할 수 있도록 합니다: cd /d “C:\faceswap\DataB\idol1” && ffmpeg -i 파일이름.mp4 -vf fps=2 clip%05d.png 파일이름.mp4는 영상 파일 이름에 맞게 수정합니다. fps는 영상에서 추출되는 속도를 의미하며 작을 수록 더 느리게(더 적은량의 이미지)를 뽑습니다. 저는 개인적으로 fps=2을 사용합니다. 영상이 너무 짧으면 더 큰 숫자를 사용해도 되나.. 너무 과대한 숫자는 삼가시기 바랍니다.

영상에서 추출을 끝내고 결과물을 확인하여 너무 흐리거나/이상하거나/비슷한 장면들은 지우시는 걸 추천드립니다. 이들은 있어도 학습만 지연시킬 뿐 아무런 의미가 없습니다. 모든 이미지/프레임들이 idol1 폴더에 위치해 있다면 이들에서 얼굴을 추출하기 위해 아래와 같은 명령어를 입력합니다: cd /d c:\faceswap && python faceswap.py extract -i DataB\idol1 -o DataB\idol1\extracted -D mtcnn -r 45 -ae 이 과정이 끝나셨으면 다음과 같은 (C:\faceswap\DataB\idol1\extracted) 경로에 결과가 있을 것입니다.

또 한번 흐리거나/이상하거나/비슷한 얼굴들을 지우시는 걸 추천드립니다.

얼굴셋을 준비하기 위한 과정입니다. 얼굴셋이란? 256×256 이미지 크기의 아이돌 얼굴 모음집 몇개의 이미지가 한 셋에 포함되어야 할까? 효과적이고 빠른 학습을 위해서는 300~1000개 사이가 좋습니다 이미지의 품질은 어때야 될까? 얼굴이 명확해 보이는 빛 밝기, 흐림이 없고, 다른 물체(머리카락,병,마이크 등)가 얼굴을 가리지 않은 이미지가 좋습니다. 그리고 최대한 다양한 각도(위,아래,옆)와 표정이 있는 얼굴이 있는 것이 좋습니다. 특히 고개를 위로 들거나 아래로 숙인 얼굴은 찾기 어려우므로 고생하실 수도 있습니다 그래서 얼굴셋을 만드는 방법은? 가장 쉬운 방법은 다른 유저들이 만든 얼굴셋을 사용하는 겁니다. 다운받은 얼굴들을 (C:\faceswap\DataB\idol1\extracted)와 같은 경로로 복붙합니다.또는! 본인이 직접 만드시고 싶다면 faceswap을 이용하여 얼굴을 추출하여야 합니다. 목표 아이돌의 이미지를 구글 검색, pinterest 등에서 얻어서 C:\faceswap\DataB\idol1로 복붙합니다 가장 좋은 방법은 영상에서 얼굴을 얻는 것이며 이를 인터뷰, 직캠, 뮤비 등에서 얻을 수 있습니다. 영상들을 모두 C:\faceswap\DataB\idol1로 이동시킵니다 CMD를 실행시키고 아래와 같은 명령어를 입력하여 ffmpeg가 영상으로부터 프레임(이미지)을 추출할 수 있도록 합니다: cd /d “C:\faceswap\DataB\idol1” && ffmpeg -i 파일이름.mp4 -vf fps=2 clip%05d.png 파일이름.mp4는 영상 파일 이름에 맞게 수정합니다. fps는 영상에서 추출되는 속도를 의미하며 작을 수록 더 느리게(더 적은량의 이미지)를 뽑습니다. 저는 개인적으로 fps=2을 사용합니다. 영상이 너무 짧으면 더 큰 숫자를 사용해도 되나.. 너무 과대한 숫자는 삼가시기 바랍니다.

영상에서 추출을 끝내고 결과물을 확인하여 너무 흐리거나/이상하거나/비슷한 장면들은 지우시는 걸 추천드립니다. 이들은 있어도 학습만 지연시킬 뿐 아무런 의미가 없습니다. 모든 이미지/프레임들이 idol1 폴더에 위치해 있다면 이들에서 얼굴을 추출하기 위해 아래와 같은 명령어를 입력합니다: cd /d c:\faceswap && python faceswap.py extract -i DataB\idol1 -o DataB\idol1\extracted -D mtcnn -r 45 -ae 이 과정이 끝나셨으면 다음과 같은 (C:\faceswap\DataB\idol1\extracted) 경로에 결과가 있을 것입니다.

또 한번 흐리거나/이상하거나/비슷한 얼굴들을 지우시는 걸 추천드립니다.

4. 파이썬: 추출 – (DataA) 모델 얼굴셋 만들기

Expand 딥페이크를 만들기 위해서는 아이돌의 얼굴셋 뿐만 아니라 아이돌의 얼굴로 변환시킬 모델의 얼굴도 필요합니다. 이는 아이돌의 얼굴셋 만드는 경우와 같습니다. 모델 영상에서 얼굴 추출: 영상을 (C:\faceswap\DataA\actress1) 의 경로에 위치시킵니다. cmd를 실행하고 아래의 명령어를 입력합니다: cd /d C:\faceswap\DataA\actress1 && ffmpeg -i “파일이름.mp4” -vf fps=[Source FPS] clip%05d.png && cd /d C:\faceswap && python faceswap.py extract -i C:\faceswap\DataA\actress1 -o C:\faceswap\DataA\actress1\extracted -D mtcnn -r 45 -ae 파일이름.mp4은 영상 파일 이름에 맞게 수정하시고 [Source FPS]는 영상의 fps에 맞게 입력합니다. 이 명령어는 &&로 구분된 여러개의 명령어를 동시에 실행시키는 것입니다. 먼저 ffmpeg를 이용하여 영상으로 부터 프레임을 뽑고 -> 파이썬을 이용하여 출력된 프레임으로 부터 얼굴을 추출합니다.

(C:\faceswap\DataA\actress1\extracted) 경로의 폴더에 결과물이 추출될 것입니다.

추출된 결과물들을 확인하여 정말 얼굴들만 추출됐는지 확인하고 얼굴이 아닌 것이 발견될 경우 이를 지웁니다. 지우지 않으면 나중에 얼굴이 아닌 것을 얼굴로 변환시켜려는 만행을 저지르게 됩니다. 딥페이크를 만들기 위해서는 아이돌의 얼굴셋 뿐만 아니라 아이돌의 얼굴로 변환시킬 모델의 얼굴도 필요합니다. 이는 아이돌의 얼굴셋 만드는 경우와 같습니다. 모델 영상에서 얼굴 추출: 영상을 (C:\faceswap\DataA\actress1) 의 경로에 위치시킵니다. cmd를 실행하고 아래의 명령어를 입력합니다: cd /d C:\faceswap\DataA\actress1 && ffmpeg -i “파일이름.mp4” -vf fps=[Source FPS] clip%05d.png && cd /d C:\faceswap && python faceswap.py extract -i C:\faceswap\DataA\actress1 -o C:\faceswap\DataA\actress1\extracted -D mtcnn -r 45 -ae 파일이름.mp4은 영상 파일 이름에 맞게 수정하시고 [Source FPS]는 영상의 fps에 맞게 입력합니다. 이 명령어는 &&로 구분된 여러개의 명령어를 동시에 실행시키는 것입니다. 먼저 ffmpeg를 이용하여 영상으로 부터 프레임을 뽑고 -> 파이썬을 이용하여 출력된 프레임으로 부터 얼굴을 추출합니다.

(C:\faceswap\DataA\actress1\extracted) 경로의 폴더에 결과물이 추출될 것입니다.

추출된 결과물들을 확인하여 정말 얼굴들만 추출됐는지 확인하고 얼굴이 아닌 것이 발견될 경우 이를 지웁니다. 지우지 않으면 나중에 얼굴이 아닌 것을 얼굴로 변환시켜려는 만행을 저지르게 됩니다.

5. 파이썬: 학습

Expand DataA와 DataB 폴더가 준비되었으므로 이제부터 학습을 시작할 수 있습니다!

먼저 cmd를 실행시킨 다음 아래와 같은 명령어를 입력합니다: cd /d c:\faceswap && python faceswap.py train -A DataA\actress1\extracted -B DataB\idol1\extracted -m model\model1 -pl -p -t OriginalHighRes 특수/그외 케이스: GPU(그래픽카드)가 낮은 VRAM(메모리)를 갖고 있다면 학습 과정 중에 에러가 생길 수 있습니다. 에러가 만약 OOM (메모리 부족) 에러라면 배치 사이즈를 줄여서 실행해봅니다. 기본 배치 사이즈는 64이며, 바꾸고 싶을 경우 다음과 같은 명령어를 추가합니다: -bs 32

두 개의 GPU가 있으시다면, 아래와 같은 명령어를 입력함으로써 동시에 사용할 수 있습니다: cd /d c:\faceswap && python faceswap.py train -A DataA\actress1\extracted -B DataB\idol1\extracted -m model\model1 -pl -p -t OriginalHighRes -g 2 학습 실행에 성공하셨다면, cmd 창에는 A와 B의 loss(명확도)와 예상 학습 결과가 나타날 것입니다: 학습 중에는 PC를 가만히 놔두는 것이 좋습니다. 안그래도 많은 CPU와 GPU 사용량을 요구하는데 거기에 덤으로 다른 작업까지 하시면 에러가 발생할 확률이 높아집니다. 좋은 loss는 0.02~0.01 사이입니다. (저는 보통 0.019만 되면 멈춥니다) 원하시는 목표치에 도달하셨거나 중간에 멈추고 싶으시면 “training”이라는 제목을 가진 “예상 학습 결과 창”을 클릭한 상태에서 엔터를 누르면 됩니다. 그러면 학습 결과가 model의 형태로 저장이 되며, 이는 model이라고 지어준 폴더에 저장됩니다: DataA와 DataB 폴더가 준비되었으므로 이제부터 학습을 시작할 수 있습니다!

먼저 cmd를 실행시킨 다음 아래와 같은 명령어를 입력합니다: cd /d c:\faceswap && python faceswap.py train -A DataA\actress1\extracted -B DataB\idol1\extracted -m model\model1 -pl -p -t OriginalHighRes 특수/그외 케이스: GPU(그래픽카드)가 낮은 VRAM(메모리)를 갖고 있다면 학습 과정 중에 에러가 생길 수 있습니다. 에러가 만약 OOM (메모리 부족) 에러라면 배치 사이즈를 줄여서 실행해봅니다. 기본 배치 사이즈는 64이며, 바꾸고 싶을 경우 다음과 같은 명령어를 추가합니다: -bs 32

두 개의 GPU가 있으시다면, 아래와 같은 명령어를 입력함으로써 동시에 사용할 수 있습니다: cd /d c:\faceswap && python faceswap.py train -A DataA\actress1\extracted -B DataB\idol1\extracted -m model\model1 -pl -p -t OriginalHighRes -g 2 학습 실행에 성공하셨다면, cmd 창에는 A와 B의 loss(명확도)와 예상 학습 결과가 나타날 것입니다: 학습 중에는 PC를 가만히 놔두는 것이 좋습니다. 안그래도 많은 CPU와 GPU 사용량을 요구하는데 거기에 덤으로 다른 작업까지 하시면 에러가 발생할 확률이 높아집니다. 좋은 loss는 0.02~0.01 사이입니다. (저는 보통 0.019만 되면 멈춥니다) 원하시는 목표치에 도달하셨거나 중간에 멈추고 싶으시면 “training”이라는 제목을 가진 “예상 학습 결과 창”을 클릭한 상태에서 엔터를 누르면 됩니다. 그러면 학습 결과가 model의 형태로 저장이 되며, 이는 model이라고 지어준 폴더에 저장됩니다:

6. 파이썬: 변환

Expand The lazy method: in CMD, type in: cd /d c:\faceswap && python faceswap.py convert -i DataA\actress1 -o DataA\idol1 -a DataA\actress1\extracted -m model\model1 -t OriginalHiRes -D mtcnn -c Adjust -sm CMD를 켜시고 다음과 같은 명령어를 입력합니다. cd /d c:\faceswap && python faceswap.py convert -i DataA\actress1 -o DataA\idol1 -a DataA\actress1\extracted -m model\model1 -t OriginalHighRes -D mtcnn -b 10 -e 10 이는 변환의 가장 기본적인 명령어입니다.

여기에 옵션을 더 추가하시고 싶으시면 위치에 상관없이 옵션을 입력한 후 한번에 실행하시면 됩니다. (옵션을 따로따로 입력하시면 안됩니다)

추가할 수 있는 옵션은 다음과 같습니다: -S 경계선을 보이지 않게 하기 위해서는 가장 좋은 방법이나 일그러지는 현상이 자주 발생하여 추천드리지 않습니다 -b [양수] 얼굴을 덮는 범위를 흐리게 합니다 (경계선 쪽이 가장 많은 영향을 받으며, 안쪽으로 들어올수록 약해집니다) -e [양수 또는 음수] 얼굴을 덮는 범위를 줄입니다 -mh 색을 맞추는 기능을 갖고 있습니다. 그러나 가끔씩 어느 부분만 유독 밝게 빛나게 할 수 있습니다 -sh [bsharpen] or –sh [gsharpen] 날카롭게 (명확하게) 합니다. Bsharpen 은 너무 강해서 왠만해선 추천드리지 않습니다 제가 가장 자주 사용하는 명령어는 다음과 같습니다: cd /d c:\faceswap && python faceswap.py convert -i DataA\actress1 -o DataA\idol1 -a DataA\actress1\extracted -m model\model1 -t OriginalHighRes -D mtcnn -b 10 -e 10 -sh gsharpen 여기서 부터 저는 두 숫자를 5단위로 증가/감소 시키며 실험합니다. 색이 너무 안 맞을 경우 -mh를 추가합니다.

하지만 이 코드가 가장 이상적인 코드는 아님을 명심해야 합니다. 이는 제가 주관적 판단으로 정한 코드이며, 여러분들은 계속적인 실험을 통하여 영상/모델에 맞게 코들 바꿔나가시기 바랍니다.

변환이 끝나셨다면 지정하신 출력 폴더(이 경우 idol1 폴더)에 결과가 있을 것입니다. 결과에 만족하지 못하셨다면 명령어를 수정하여 다시 실행하시기 바랍니다. 출력된 프레임(결과물)들을 합치기 위해서는 cmd를 켜시고 다음과 같이 입력합니다: cd /d C:\faceswap\DataA\idol1 이는 프레임이 있는 폴더로 이동시키기 위한 명령어입니다. 이제 다음과 같이 입력합니다: ffmpeg -r fps -f image2 -s 이미지크기 -i clip%05d.png -vcodec libx264 -crf 18 -pix_fmt yuv420p out.mp4 fps는 원래 영상의 fps를 의미하며 이는 본인이 확인한 후 수정하여 입력하시면 됩니다. 예) -r 30

이미지 크기는 띄어쓰기 없이 “1280×720″으로 쓰시면 됩니다. 예) -s 1280×720 The lazy method: in CMD, type in: cd /d c:\faceswap && python faceswap.py convert -i DataA\actress1 -o DataA\idol1 -a DataA\actress1\extracted -m model\model1 -t OriginalHiRes -D mtcnn -c Adjust -sm CMD를 켜시고 다음과 같은 명령어를 입력합니다. cd /d c:\faceswap && python faceswap.py convert -i DataA\actress1 -o DataA\idol1 -a DataA\actress1\extracted -m model\model1 -t OriginalHighRes -D mtcnn -b 10 -e 10 이는 변환의 가장 기본적인 명령어입니다.

여기에 옵션을 더 추가하시고 싶으시면 위치에 상관없이 옵션을 입력한 후 한번에 실행하시면 됩니다. (옵션을 따로따로 입력하시면 안됩니다)

추가할 수 있는 옵션은 다음과 같습니다: -S 경계선을 보이지 않게 하기 위해서는 가장 좋은 방법이나 일그러지는 현상이 자주 발생하여 추천드리지 않습니다 -b [양수] 얼굴을 덮는 범위를 흐리게 합니다 (경계선 쪽이 가장 많은 영향을 받으며, 안쪽으로 들어올수록 약해집니다) -e [양수 또는 음수] 얼굴을 덮는 범위를 줄입니다 -mh 색을 맞추는 기능을 갖고 있습니다. 그러나 가끔씩 어느 부분만 유독 밝게 빛나게 할 수 있습니다 -sh [bsharpen] or –sh [gsharpen] 날카롭게 (명확하게) 합니다. Bsharpen 은 너무 강해서 왠만해선 추천드리지 않습니다 제가 가장 자주 사용하는 명령어는 다음과 같습니다: cd /d c:\faceswap && python faceswap.py convert -i DataA\actress1 -o DataA\idol1 -a DataA\actress1\extracted -m model\model1 -t OriginalHighRes -D mtcnn -b 10 -e 10 -sh gsharpen 여기서 부터 저는 두 숫자를 5단위로 증가/감소 시키며 실험합니다. 색이 너무 안 맞을 경우 -mh를 추가합니다.

하지만 이 코드가 가장 이상적인 코드는 아님을 명심해야 합니다. 이는 제가 주관적 판단으로 정한 코드이며, 여러분들은 계속적인 실험을 통하여 영상/모델에 맞게 코들 바꿔나가시기 바랍니다.

변환이 끝나셨다면 지정하신 출력 폴더(이 경우 idol1 폴더)에 결과가 있을 것입니다. 결과에 만족하지 못하셨다면 명령어를 수정하여 다시 실행하시기 바랍니다. 출력된 프레임(결과물)들을 합치기 위해서는 cmd를 켜시고 다음과 같이 입력합니다: cd /d C:\faceswap\DataA\idol1 이는 프레임이 있는 폴더로 이동시키기 위한 명령어입니다. 이제 다음과 같이 입력합니다: ffmpeg -r fps -f image2 -s 이미지크기 -i clip%05d.png -vcodec libx264 -crf 18 -pix_fmt yuv420p out.mp4 fps는 원래 영상의 fps를 의미하며 이는 본인이 확인한 후 수정하여 입력하시면 됩니다. 예) -r 30

이미지 크기는 띄어쓰기 없이 “1280×720″으로 쓰시면 됩니다. 예) -s 1280×720

Congratulations!

You’ve just created your first Deepfake.

If you want to start becoming a creator on our site, please send your finished videos to an admin on our Discord server for assessment.

Please include our unique Intro at the beginning and the Logo inside of the video as well!

Disclaimer: You are in full responsibility of the content you create. We at DFKP offer this tutorial for educational purposes, do this on your own risk.We’re not responsible for any kind of damages to your system or malicious content that you create.

Questions? Comments?

Go over to our forums if you have any questions or comments

[Deep Fake Tutorial] 나만의 딥페이크(Deep fake) 만들기(수지를 아이유로?)

DFL(DeepFaceLab)실행 환경 설정

DFL은 중국에서 개발 및 배포된 소스로, 소스 영상에서 얼굴을 추출하여 타겟 영상에 합성, 손쉽게 Deep fake를 만들 수 있음

출처 : DeepFaceLab

DFL 가상환경 만들기

conda create -y -n deepfacelab python=3.6.6 cudatoolkit=9.0 cudnn=7.3.1 conda activate deepfacelab

clone DFL

git clone https://github.com/dream80/DeepFaceLab_Linux.git

Requirement 설치

cd DeepFaceLab_Linux python -m pip install -r requirements-cuda.txt

ffmpeg 설치(conda)

conda install ffmpeg==4.0.2 conda insatll ffmpeg

Tensor version 맞추기(CUDA 10.0 기준)

conda install tensorflow-gpu==1.13.1 # 이때 cudatoolkit, cudnn 등 설치 됨 conda install tensorflow==1.13.1 conda install tensorboard==1.13.1

workspace에 영상 넣기

영상은 자유롭게 넣되, 아래와 같이 naming

합성하고 싶은 얼굴이 든 영상은 : data_src. mp4

합성 대상 영상 : data_dst.mp4

$ scp -P 16022 ./data_src.mp4 {개인서버 개정}@{서버주소}:{DeepFaceLab 경로}/DeepFaceLab_Linux/workspace/ $ scp -P 16022 ./data_dst.mp4 {개인서버 개정}@{서버주소}:{DeepFaceLab 경로}/DeepFaceLab_Linux/workspace/

본 예시에서는 수지 광고 영상에 아이유의 얼굴을 합성할 것임

이 아이유를 요 수지로 합성

DFL 실행

1. env 실행

DeepFaceLab_Linux/script/env.sh

export DFL_CUDA=”CUDA_VISIBLE_DEVICES=1″ export DFL_PYTHON=”python3.6″ export DFL_WORKSPACE=”../workspace” if [ ! -d “$DFL_WORKSPACE” ]; then mkdir “$DFL_WORKSPACE” mkdir “$DFL_WORKSPACE/data_src” mkdir “$DFL_WORKSPACE/data_src/aligned” mkdir “$DFL_WORKSPACE/data_src/aligned_debug” mkdir “$DFL_WORKSPACE/data_dst” mkdir “$DFL_WORKSPACE/data_dst/aligned” mkdir “$DFL_WORKSPACE/data_dst/aligned_debug” mkdir “$DFL_WORKSPACE/model” fi export DFL_SRC=”../”

2. data_src 프레임 추출

$ ./2_extract_PNG_from_video_data_src.sh

3. data_dst 프레임 추출

$ ./3_extract_PNG_from_video_data_dst.sh

3-1. data_dst denoise(optional)

$ ./3_other_denoise_extracted_data_dst.sh

4. data_src 프레임에서 face 추출

face 추출의 경우 S3FD, MT 등 option이 있으나 S3FD권장

이 작업은 환경이 CPU일 때 매우 느리게 작동함

$ ./4_data_src_extract_faces_S3FD_best_GPU.sh

이렇게 프레임에서 얼굴만 잘라줌

4.1. face를 유사 히스토그램으로 정렬

similar_histogram : 이 옵션은 추출된 face를 유사 히스토그램으로 정렬 해준다

소스 영상에 원하는 사람의 얼굴(아이유)이 아닌 타인의 얼굴이 있을 때 제거가 용이하다

$ ./4.2.2_data_src_sort_by_similar_histogram.sh

4.1. face를 final option으로 정렬

final : 권장되는 정렬로, 소스로 활용하기 좋지 않은 프레임을 버리고, 필요한 프레임(yaw 기준으로 다양하게)만 남겨준다

$ ./4.2.6_data_src_sort_by_final.sh

5. data_dst 프레임에서 face 추출

$ ./5_data_dst_extract_faces_S3FD_best_GPU.sh

6. model train

model도 여러가지가 있는데, blending 할 때 option이 다양한 SAE로 실행

학습이 정상적으로 실행되면 아래와 같은 미리보기 이미지가 workspace/model에 저장됨

$ ./6_train_SAE.sh

iter : 100 iter : 20,000

7. Convert

$ ./7_convert_{사용한 모델명}.sh

아래와 같이 merged된 프레임을 workspace/data_dst/merged 경로에 얻을 수 있다.

convert를 진행하다보면 많은 option이 있는데, 이를 어떻게 조정하느냐에 따라 영상의 자연스러움이 다르다

converting option을 기본 값으로 준 것 조금 더 자연스럽도록 option을 수정한 것 원본 이미지(좌)와 합성된 이미지(우)

위 예시에서 알 수 있듯 완벽히 합성되지 않는 frame 들이 있다(사실상 자연스러운 부분이 더 적음)

턱의 검은 건 왜 생긴지 알 수가 없고, 미표한 표정의 변화까지 완벽히 합성되지는 않는 모양

8. mp4 영상으로 추출

추출된 영상은 /workspace 안에 result.mp4 로 저장된다.

$ ./8_converted_to_mp4.sh

합성된 딥페이크 영상

9. review

GPU 환경에서 train에 약 16시간 정도 소요, 가치가 있나..(ㅎㅎ)

Youtube 등에서 훨씬 자연스럽게 합성된 deep fake 들에 비해 뭐가 부족한걸까?

합성된 영상은 퀄리티를 더 높이려면 어떤 시도를 할 수 있을지?

특정 헤어스타일이 어울릴지에 대한 의사결정에 좋을 것 같다(?)

728×90

So you have finished reading the 파이썬 딥 페이크 topic article, if you find this article useful, please share it. Thank you very much. See more: 딥페이크 처벌, Face Swap 사용법, 딥페이크 만들기 사이트, 딥페이크 github, 딥페이크 시청 처벌, Deep Swap 사용법, Faceswap, Face Swap 사진